AI動画生成技術は近年急速に進化し、テキストや画像から高品質な映像を生成できるだけでなく、音声表現や人物の動き、物理的な整合性まで再現可能な段階へと進みつつあります。特に 2025 年以降、Veo 3、Sora 2、Hailuo 2.3 をはじめとする新世代のAI動画生成モデルが相次いで登場し、用途や特性の多様化が一層進んでいます。

一方で、モデルごとの性能差や得意分野を客観的に比較できる情報はまだ限られており、企業やクリエイターにとって「どのモデルを、どの目的で活用すべきか」を判断することは容易ではありません。

こうした背景を受け、LitMediaが提供するAI動画生成プロダクト「LitVideo」はこのたび、主要なAI動画生成モデル7種以上を対象とした横断的な技術検証レポートを公開しました。本検証では、すべてのモデルを同一条件下で比較し、生成品質や指示理解力、音声と映像の同期精度、物理表現の傾向などを多角的に分析しています。

目次

AI動画生成市場の現状と今後の展望

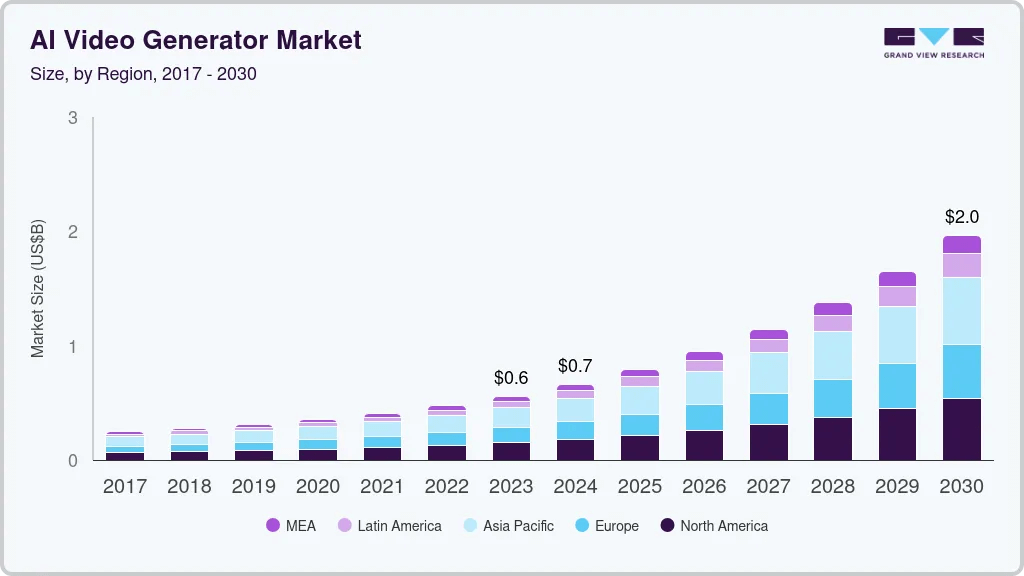

近年、AI動画生成技術は急速に普及しており、企業やクリエイターの動画制作環境に大きな変革をもたらしています。市場調査によると、2023年のグローバルAI動画生成器市場規模は約5.549億米ドルと推定され、2024年から2030年にかけて年平均成長率(CAGR)19.9%で拡大し、2030年には約19.5924億米ドルに達すると予測されています。

市場成長の主な要因として、企業や消費者の映像コンテンツ需要の増加が挙げられます。現在、ネット上のトラフィックの約80%は動画コンテンツによるもので、視覚情報への依存度が高まっていることがわかっています。また、高速インターネット環境の普及やSNS利用者数の増加も、動画生成ツールの需要を後押ししています。

地域別では、2023年時点でアジア太平洋地域が最大の市場シェア(31.40%)を占めており、同地域におけるAI動画生成ソフトウェアの広範な導入と顧客基盤が市場拡大の主要要因となっています。コンポーネント別では、ソリューション型サービスが全体収益の63.31%を占め、企業規模別では大企業が主導的な市場収益シェアを保持しています。さらに、テキストから動画を生成する技術(Text-to-Video)が、今後も市場を牽引する分野として注目されています。

このように、AI動画生成市場は「短時間・低コストでの制作」「高度な映像表現」「多様な配信フォーマットへの対応」といったニーズを背景に、今後さらに拡大していくことが見込まれます。

こうした市場背景を踏まえ、本稿ではLitMediaが提供するAI動画生成ツール「LitVideo」を活用し、主要モデルを統一条件下で検証した手法と評価軸を報告します。これにより、市場動向だけでなく、各モデルの生成性能や用途適性を客観的に示すことを目的としています。

検証方法|LitVideoを用いた統一条件テスト

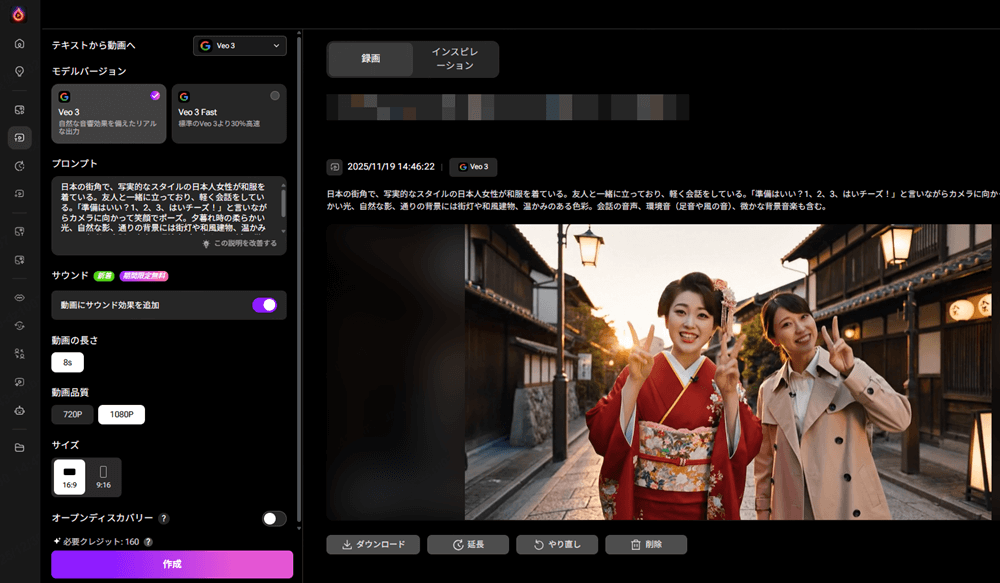

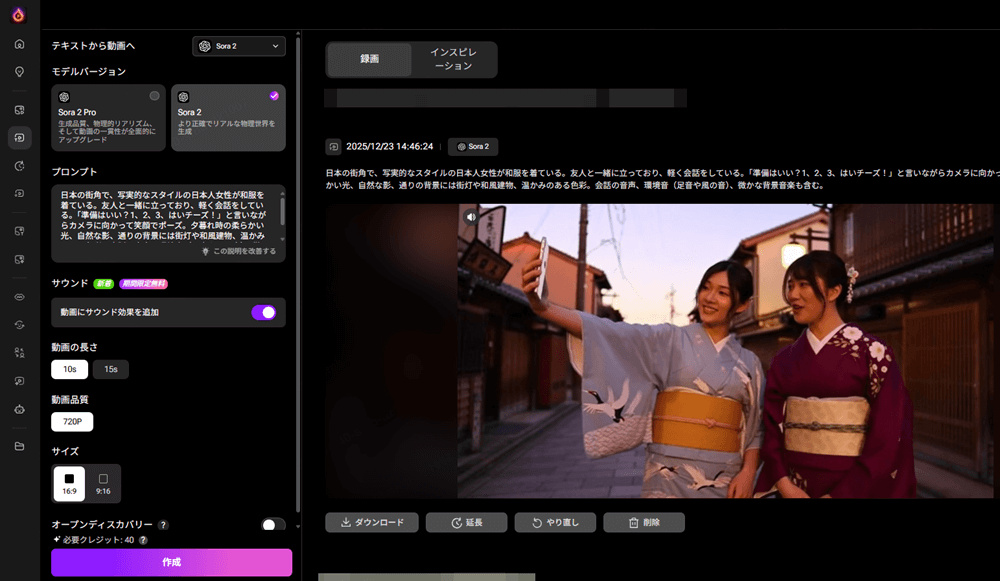

本検証では、複数のAI動画生成モデルを公平かつ客観的に比較するため、LitVideo を検証プラットフォームとして活用しました。モデルごとの仕様差や操作環境の影響を最小限に抑えるため、すべての生成テストは以下の条件を統一したうえで実施しています。

まず、各モデルには同一のテキストプロンプトを入力し、シーン構成や演出意図がどの程度正確に再現されるかを確認しました。あわせて、動画尺(再生時間)および生成設定を揃えることで、映像品質や動きの表現差がモデル固有の特性によるものかを検証しています。

評価にあたっては、単なる映像の美しさだけでなく、実用面を意識した複数の評価軸を設定しました。具体的には、以下の観点から総合的に分析を行っています。

- 生成品質:映像の鮮明さ、ノイズや破綻の有無、全体の安定性

- 指示理解力:プロンプトの内容がどの程度正確に反映されているか

- 音画同期:セリフや音声と人物の口の動き、アクションとの整合性

- 物理的整合性:人物や物体の動きにおける重力、接触、動作の自然さ

これらの評価軸を通じて、各AI動画生成モデルがどのような用途や制作フェーズに適しているのか、また現在の技術的到達点と課題がどこにあるのかを明らかにすることを目的としています。

統一テスト用プロンプト(LitVideo検証)

本グループの比較検証では、以下の日本語プロンプトを全モデルに共通して使用しました。

このプロンプトにより、写実性・人物表情・音声同期・雰囲気演出の差異を横断的に比較しています。

音声統合型・最上位AI動画生成モデルの比較検証

AI動画生成モデルの中でも、Veo 3 と Sora 2 は「映像と音声を同時に生成できる」という点で、現行世代の最上位カテゴリに位置づけられます。両モデルはともに、単なる映像生成にとどまらず、対話音声・環境音・BGM を含めた“完成形の動画”を一工程で生成できる点が大きな特徴です。

本検証では、LitVideo 上で同一プロンプトを使用し、両モデルの生成結果を比較しました。ここでは、画質の優劣だけでなく、指示理解、音画同期、物理表現といった観点から、それぞれの特性を整理します。

① Veo 3(Google)

音声統合型生成を実用段階へ押し上げた先行モデル

Google が 2025 年 5 月に発表した Veo 3 は、AI動画生成分野において初めて「動画と音声を同時に生成する」ことを本格的に実用化したモデルです。従来は、映像生成後に別工程で音声を追加する必要がありましたが、Veo 3 では単一のテキスト指示から、映像・環境音・効果音・対話音声・BGM をまとめて生成できます。

LitVideo 上での検証では、最大 8 秒・1080p の動画生成において、光の表現や環境描写が安定しており、夕景や屋外シーンなどで自然なライティングが確認されました。また、人物の口の動きと発話音声が一致する「リップシンク」が実装されており、会話シーンでは実写映像に近い一体感が得られます。

同一プロンプトによる生成結果の比較について

一方で、プロンプトの記述が非常に具体的かつ抽象表現を多く含む場合、意図の解釈が硬直化する傾向も見られました。特定の構図やカメラワーク、時間的変化を細かく指定したケースでは、前後のシーン整合性や物理的自然さが部分的に崩れる場面が確認されています。

プロンプトの描写が抽象的な場合、意図が十分に伝わらず、下記のように不自然な映像が生成されるケースが確認されました。

総じて Veo 3 は、「音声込みで完成度の高い短尺映像を即座に生成する」点において非常に強力であり、広告、デモ映像、シネマティックな短編制作に向いたモデルといえます。

② Sora 2(OpenAI)

指示理解と物理再現を重視した汎用型高精度モデル

OpenAI が 2025 年 9 月に公開した Sora 2 は、テキストから動画を生成するモデルとして、特に「指示理解の柔軟性」と「物理挙動の再現性」に重点を置いた設計が特徴です。従来の招待制から公開提供へ移行したことで、対応地域では一般ユーザーも利用可能となりました。

LitVideo による同一プロンプト検証では、Sora 2 は場面の文脈を読み取り、指定されていない細部についても自然に補完する傾向が見られました。人物同士の距離感、視線、簡単な身振りなどが自動的に補われ、対話音声と動作の同期も比較的安定しています。

音声生成機能も搭載されており、環境音や簡単な BGM、対話音声を映像と同時に生成できます。ただし、画面全体の美術的完成度や光の演出については、Veo 3 と比較するとやや控えめで、写実性よりも整合性を優先する傾向が見受けられました。

また、Sora 2 では実在人物の顔や声の扱いに関して厳格な制限が設けられており、生成動画には C2PA メタデータとウォーターマークが付与されます。これにより、商用利用や情報信頼性の面では一定の安心感が確保されています。

短尺動画を中心に、SNS コンテンツ、広告、ストーリー性のある映像制作など、幅広い用途に対応可能なモデルといえるでしょう。

本セクションのまとめ

この差異は、用途選択に直結します。完成度の高い演出重視の映像か、柔軟な指示対応と安定性を重視するかによって、適切なモデルは異なります。本レポートでは、同一プロンプトによる生成結果を通じて、こうした特性の違いを可視化しています。

高効率・量産型AI動画モデル群の検証

Veo 3 や Sora 2 のように「表現の上限」を追求する最上位モデルとは異なり、AI動画生成市場では現在、制作スピード・コスト効率・量産性を重視したモデル群の存在感が急速に高まっています。

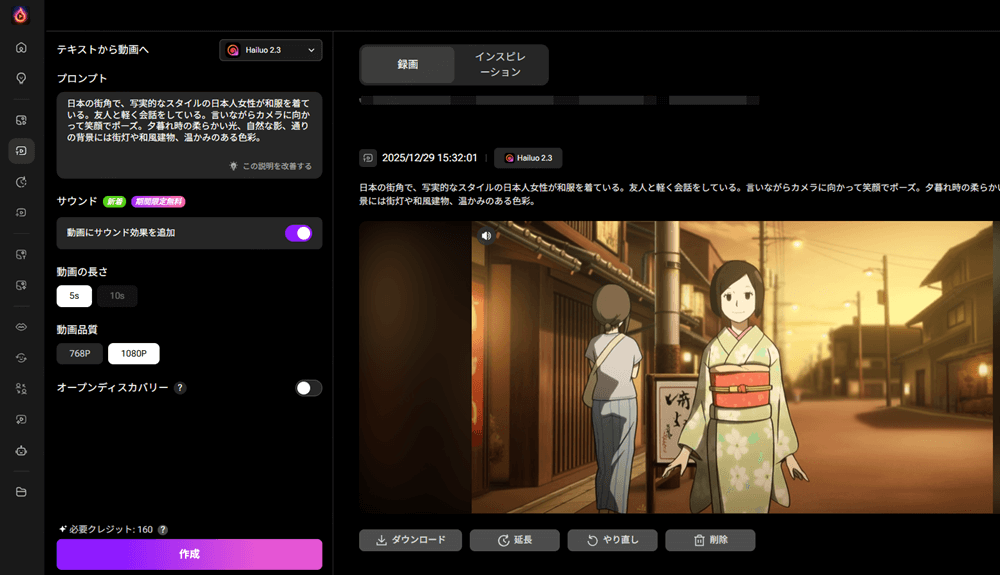

本章では、LitVideoによる同一条件テストを通じて、Hailuo 2.3(MiniMax)・Seedance・Wan 2.2の3モデルを取り上げ、それぞれがどの制作フェーズに適しているのかを検証します。

これらのモデルは、必ずしも「完璧な写実性」や「高度な音声同期」を第一目的とせず、十分な品質を安定して大量に生成することを軸に設計されている点が共通しています。

① Hailuo 2.3(MiniMax)

MiniMax が提供する Hailuo 2.3 は、従来モデルである Hailuo 2をベースに、コスト据え置きで出力品質と生成効率を向上させた改良版として位置づけられています。

LitVideoの検証環境においても、Hailuo 2.3 は「1分あたりの生成コスト」と「処理スループット」の面で優位性を示しました。

同一プロンプトによる生成テストでは、写実的な日本人女性を描写する指示に対し、一貫して漫画調・イラスト寄りの表現が出力される傾向が確認されています。これは指示理解の精度というよりも、モデル側が想定するデフォルトスタイルが強く反映される設計思想によるものと考えられます。

一方で、シーン構成や色調、雰囲気表現については安定しており、プロダクトループ映像、簡易Bロール、短尺スタイル動画など、フォーマットが固定された量産用途では高い実用性を発揮します。 音声生成は本モデルの主軸ではなく、映像単体を前提とした制作パイプライン向けの設計である点も明確です。

MiniMax が提供する「高速プラン」により、大量素材を短時間で処理するワークフローとの親和性は非常に高く、APIやパートナープラットフォーム経由での活用を前提としたモデルと言えます。

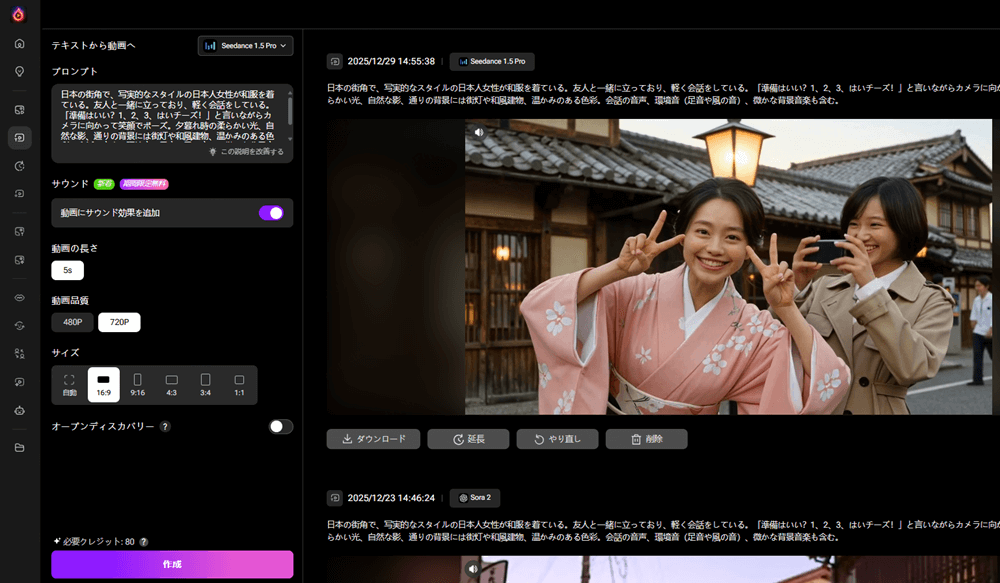

② Seedance(ByteDance)

ByteDance が開発・運用する Seedance は、スタイル変換と映像安定性を重視した画像・動画生成モデル群として設計されています。 イラスト、油絵、アニメ、スケッチといった参照美学を取り込みながら、被写体の構造や動きを破綻させにくい点が大きな特徴です。

LitVideoでの同一プロンプト検証では、人物の表情、動作、画面全体の統一感が安定しており、広告素材やブランド動画を想定した場合の再現性の高さが確認されました。

特に Seedance 1.5 では、背景音や環境音、簡易的なボイス要素が映像と同期して生成され、Veo 3とSora2に近い「映像+音」の一体生成が可能になっています。

建築的には、空間情報と時間情報を分離して処理する構造を採用しており、AI動画で起こりがちなフリッカーや被写体崩れを抑制しています。 この設計は、短編ストーリー、広告、ブランドキャンペーンといった用途で特に有効であり、「美しさ」と「安定性」のバランスを重視する現場向けのモデルと評価できます。

③ Wan 2.2

Wan 2.2 は、光・色・構図といった映画的要素に加え、大きな動きや複雑なモーションの再現を強く意識して設計されたモデルです。 LitVideoの検証では、カメラワークや被写体の移動、アクションの連続性において、非常に滑らかな出力が確認されています。

本モデルは、混合専門家(MoE)アーキテクチャを採用し、ノイズレベルに応じて異なる専門モデルを切り替えることで、高い運動精度とディテール表現を両立しています。その結果、群集移動やダイナミックな身体動作など、他モデルでは破綻しやすいシーンでも安定した映像が生成されました。

一方で、音声生成や人物対話の再現については限定的であり、唇形同期や自然なセリフ生成といった点では、Veo 3、Sora2 や Seedance 1.5 に劣る結果となっています。 Wan 2.2 はあくまで「動きの正確さ」を重視するモデルであり、映像演出を主軸とした制作フェーズでの活用が適しています。

本セクションのまとめ

LitVideoの検証結果からは、用途ごとにモデルを使い分けることが、AI動画制作の現実解になりつつあることが明確になりました。

表現重視型・マルチモーダル志向モデルの比較

AI動画生成モデルの進化は、「解像度」や「長さ」といった定量指標から、「表現」「演出」「一貫性」といった定性的要素へと評価軸が移行しつつあります。本章では、映画的な制御や演技表現、視覚的一貫性を重視するモデル群として、Vidu と PixVerse を中心に検証結果を整理します。

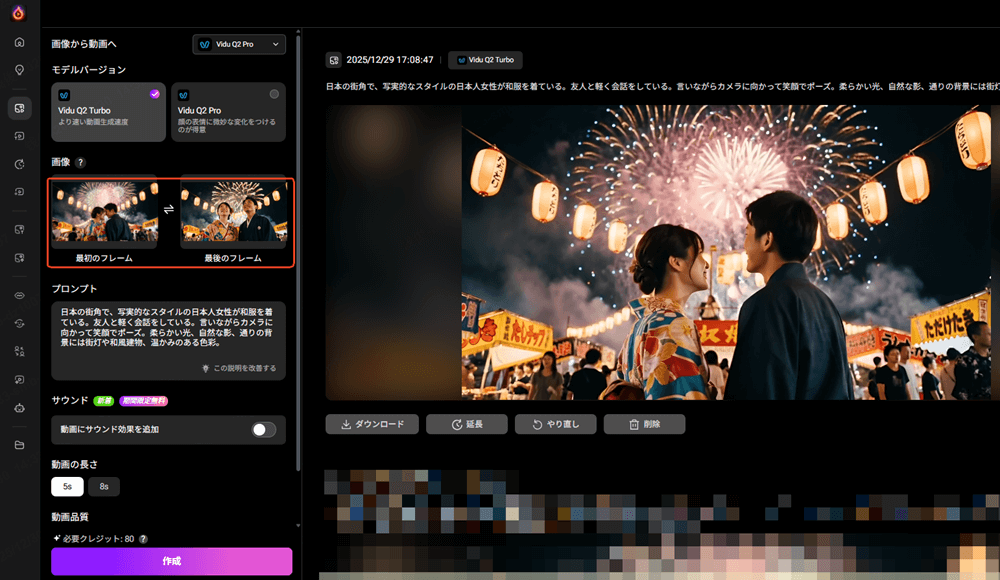

① Vidu(ShengShu Technology × 清華大学)

表現と演技を軸に進化する“AI Performer”型モデル

Vidu は、清華大学との共同研究を背景に開発されたマルチモーダルAI動画生成プラットフォームであり、単なる映像生成ではなく「パフォーマンスの再現」を重視した設計思想を持ちます。U-ViT アーキテクチャを採用した拡散モデルにより、最大16秒・1080pの動画生成を単一パスで実現できる点が技術的特徴です。

2025年初頭に登場した Vidu Q1 では、AI音効生成と「ファーストフレームからラストフレーム」までを一貫して制御する生成パイプラインが導入され、異なるシーン間を映画的に接続する能力が大きく向上しました。続く Vidu Q2 では、微細な表情変化や感情表現、いわば「AI演技」とも言える要素に焦点が当てられ、被写体の表現密度がさらに高められています。

Viduはテキストから動画を生成する用途(Text-to-Video)においては、性能面で明確な課題が確認されました。LitVideo による同一プロンプト検証では、画面の解像感、人物表現、全体の美感にばらつきが見られ、指示文に基づく対話音声の生成も確認できませんでした。

その反面、画像から動画を生成するユースケースでは非常に高い完成度を示しています。複数の参照画像をアップロードすることで、人物の表情や感情、細部の一貫性を保ったまま動画化でき、異なる角度の素材を自然に接続する能力は本検証内でも際立っていました。キャラクター表現やアニメ調コンテンツにおいて、Vidu は明確なポジションを築いているモデルと言えます。

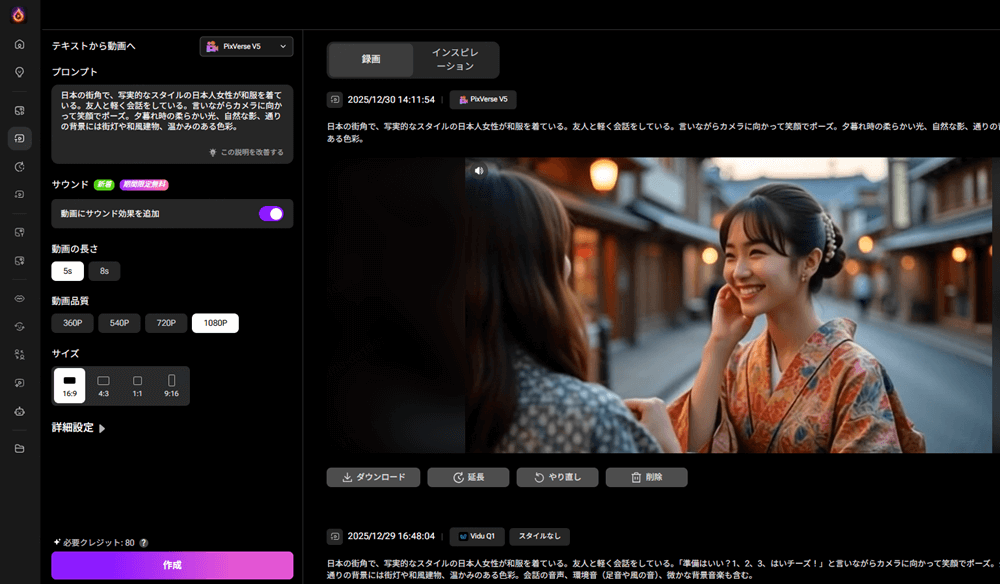

② PixVerse|高速生成と映像完成度を両立した実用型モデル

PixVerse は、短時間で高品質な映像を生成できる点から、市場成長速度の速いAI動画ツールの一つとして注目されています。シンプルなテキスト入力から1分以内で映像を生成でき、操作性の高さと安定したレンダリング品質が評価されています。

また、無料プランでもウォーターマークなしでHD出力が可能である点は、他モデルと比較して明確な差別化要素です。16:9 や 9:16 など複数アスペクト比への対応も、SNS・縦型動画を前提とした運用を強く意識した設計と言えます。

検証結果からは、被写界深度や光源処理、人物の基本的な動作において自然さが保たれており、全体として「撮影素材に近い」印象を与える画作りが確認できました。特にカラーグレーディングや合成処理がクリーンで、後処理感が少ない点は広告や情報配信用途に適しています。

一方で、PixVerse 自体には音声や音楽を生成する機能は搭載されていません。今回の検証で使用した動画内の音声は、すべて LitVideo 側の補完機能によるものです。そのため、単体で完結する動画生成というよりも、「映像素材を高速に作るためのツール」としての性格が明確です。

本セクションのまとめ

Vidu は「人物・感情・一貫性」に強く、PixVerse は「即時生成・視覚品質・配信適性」に強い。いずれも、制作工程の一部を効率化する実務向けモデルとしての価値が確認されています。

まとめ

本検証を通じて明らかになったのは、AI動画生成モデルは「どれが最も優れているか」ではなく、「どの用途に最も適しているか」という観点で評価すべき段階に入っているという点です。

文章指示から映像を構成する能力、参考画像をもとに人物や世界観を安定して再現する力、音声や動きとの整合性など、各モデルの強みと限界は明確に分かれつつあります。

たとえば、抽象的な指示から一貫した映像を構築する点ではモデル間に品質差が見られ、一方で、複数の参考画像を活用した人物表現やカット間のつながりでは、特定のモデルが優位性を示しました。このような傾向は、単発の生成結果ではなく、同一条件・同一プロンプト下での比較検証によって初めて把握できるものです。

LitMediaが提供するLitVideoは、こうした比較検証の結果を実際の制作判断に活かせる環境を提供しています。複数の主要AI動画生成モデルを横断的に試しながら、目的に合った生成結果を効率的に確認できるため、企業の検証用途からクリエイターの制作フローまで幅広く対応可能です。 AI動画生成を「試す段階」から「使い分ける段階」へ進めたい方は、ぜひLitVideoで各モデルの違いを体験してみてください。